Narodziny sowieckiego systemu obrony przeciwrakietowej. Długa droga do układów scalonych

Standaryzacja

Co do pierwszego zadania - tutaj, niestety, jak wspomnieliśmy w poprzednim artykule, w ZSRR nie było zapachu standaryzacji komputerowej. Była to największa plaga sowieckich komputerów (na równi z urzędnikami), której w ten sam sposób nie można było przezwyciężyć. Idea standardu jest często niedocenianym konceptualnym odkryciem człowieczeństwa, godnym stawienia się na równi z bombą atomową.

Standaryzacja zapewnia unifikację, potokowanie, ogromne uproszczenie i redukcję kosztów wdrożenia i wsparcia oraz niesamowitą łączność. Wszystkie części są wymienne, maszyny mogą być stemplowane w dziesiątkach tysięcy, pojawia się synergia. Pomysł ten został 100 lat wcześniej zastosowany do broni palnej. bronie40 lat wcześniej do samochodu – wyniki wszędzie były przełomowe. Jest to tym bardziej uderzające, że dopiero w USA pomyślano o zastosowaniu go w komputerach. W końcu, kiedy pożyczyliśmy IBM S/360, nie ukradliśmy samego mainframe'a, nie jego architektury, ani przełomowego sprzętu. Absolutnie wszystko to mogło być z łatwością domowe, mieliśmy wystarczająco dużo bezpośrednich rąk i jasnych głów, pomysłowych (i jak na zachodnie standardy) technologii i maszyn było pod dostatkiem - seria M Kartseva, Setun, MIR, można wymieniać przez długi czas . Kradnąc S/360, zapożyczyliśmy przede wszystkim coś, czego nie mieliśmy jako klasy w ogóle przez wszystkie lata rozwoju technologii elektronicznych do tego momentu – ideę standardu. To był najcenniejszy nabytek. I, niestety, fatalny brak pewnego konceptualnego myślenia poza marksizmem-leninizmem i „genialnym” sowieckim kierownictwem nie pozwolił nam z góry tego zrealizować na własną rękę.

Jednak o S/360 i UE porozmawiamy później, to bolesny i ważny temat, który wiąże się również z rozwojem komputerów wojskowych.

Standaryzację w technologii komputerowej wprowadziła najstarsza i największa firma sprzętowa - oczywiście IBM. Do połowy lat pięćdziesiątych przyjmowano za pewnik, że komputery były budowane pojedynczo lub w małych partiach po 1950-10 maszyn i nikt nie przypuszczał, że będą one kompatybilne. Wszystko zmieniło się, gdy IBM, zachęcony przez swojego odwiecznego konkurenta UNIVAC (który właśnie budował superkomputer LARC), zdecydował się zbudować najbardziej złożony, największy i najpotężniejszy komputer lat 50. - IBM 1950 Data Processing System, lepiej znany jako Stretch. Pomimo zaawansowania bazy elementów (maszyna była przeznaczona dla wojska, dlatego IBM otrzymał od nich ogromną liczbę tranzystorów) złożoność Stretcha była wygórowana - konieczne było opracowanie i zamontowanie ponad 7030 30 płyt z kilkudziesięcioma elementy na każdym.

Wspaniali ludzie pracujący nad Stretch to między innymi Gene Amdahl (późniejszy programista S/360 i założyciel Amdahl Corporation), Frederick P. Brooks (Jr. również programista S/360 i autor koncepcji architektury oprogramowania) oraz Lyle Johnson (Lyle R. Johnsona, autora koncepcji architektury komputerowej).

Pomimo kolosalnej mocy maszyny i ogromnej liczby innowacji, komercyjny projekt całkowicie się nie powiódł - osiągnięto tylko 30% zapowiadanych osiągów, a prezes firmy Thomas J. Watson Jr. proporcjonalnie obniżył cenę 7030 kilkakrotnie, co prowadziło do dużych strat.

Projekt Stretch został później nazwany przez Jake'a Widmana (Jake Widman's Lessons Learned: IT's Biggest Project Failures, PC World, 09.10.08) jako jeden z 10 największych niepowodzeń zarządzania w branży IT. Lider rozwoju, Stephen Dunwell, przyjął karę za komercyjną porażkę Stretcha, ale wkrótce po fenomenalnym sukcesie System/360 w 1964 roku zauważył, że większość jego podstawowych pomysłów została po raz pierwszy zastosowana w 7030. W rezultacie nie tylko mu wybaczono, ale także w 1966 otrzymał formalne przeprosiny i otrzymał honorowego członka IBM.

Technologie 7030 wyprzedziły czasy — wstępne pobieranie instrukcji i operandów, arytmetyka równoległa, ochrona, przeplatanie i bufory zapisu pamięci RAM, a nawet ograniczona forma wykonywania resekwencjonowania zwana wstępnym wykonywaniem instrukcji — pradziadek tej samej technologii w Pentium procesory. Co więcej, procesor był potokowy, a maszyna była w stanie przesyłać (za pomocą specjalnego koprocesora kanałowego) dane z pamięci RAM bezpośrednio do urządzeń zewnętrznych, odciążając centralny procesor. Była to dość droga wersja technologii DMA (Direct Memory Access), której używamy dzisiaj, chociaż kanały Stretch były zarządzane przez oddzielne procesory i miały wielokrotnie większą funkcjonalność niż obecne słabe implementacje (i były o rząd wielkości droższe!) . Później ta technologia została przeniesiona na S/360.

Zakres IBM 7030 był ogromny - rozwój bomb atomowych, meteorologia, obliczenia dla programu Apollo. Tylko Stretch mógł to wszystko zrobić dzięki ogromnej ilości pamięci i niesamowitej szybkości przetwarzania. W indeksatorze można było wykonać do sześciu instrukcji w locie, a do preselektorów i równoległej jednostki ALU można było jednocześnie załadować do pięciu instrukcji. Tak więc w danym momencie do 11 poleceń może znajdować się na różnych etapach wykonywania - jeśli zignorujemy przestarzałą bazę elementów, to nowoczesne mikroprocesory nie są daleko od tej architektury. Na przykład Intel Haswell przetwarza do 15 różnych instrukcji na zegar, czyli tylko o 4 więcej niż w procesorze z lat 1950-tych!

Zbudowano dziesięć systemów, program Stretch kosztował IBM 20 milionów dolarów, ale jego dziedzictwo technologiczne było tak bogate, że szybko pojawiły się produkty, które odniosły sukces komercyjny. Pomimo krótkiej żywotności 7030 przyniósł wiele korzyści, a architektonicznie był jedną z pięciu najważniejszych maszyn na świecie. Historie.

Jednak IBM uznał niefortunny odcinek za porażkę i właśnie z tego powodu programiści wyciągnęli główną lekcję - projektowanie z żelaza nigdy nie było już sztuką anarchistyczną. Stało się nauką ścisłą. W wyniku swojej pracy Johnson i Brooke napisali przełomową książkę, opublikowaną w 1962 roku, Planowanie systemu komputerowego: Rozciąganie projektu.

Projekt komputera został podzielony na trzy klasyczne poziomy: opracowanie systemu instrukcji, opracowanie mikroarchitektury implementującej ten system oraz opracowanie architektury systemowej maszyny jako całości. Ponadto w książce po raz pierwszy użyto klasycznego terminu „architektura komputerowa”. Metodologicznie była to praca bezcenna, biblia projektantów sprzętu i podręcznik kilku pokoleń inżynierów. Przedstawione tam idee zostały zastosowane przez wszystkie amerykańskie korporacje komputerowe.

Do jej publikacji w 1965 roku przyczynił się niestrudzony pionier cybernetyki, wspomniany już Kitov (nie tylko fenomenalnie oczytana osoba, jak Berg, stale śledzący zachodnią prasę, ale prawdziwy wizjoner (Projektowanie ultraszybkich systemów: Stretch). Kompleks; pod redakcją A.I. Kitov - M .: Mir, 1965). Książka została zmniejszona o prawie jedną trzecią i pomimo tego, że w rozszerzonej przedmowie Kitov kładł nacisk na główne zasady architektoniczne, systemowe, logiczne i programowe budowy komputerów, przeszła ona prawie niezauważona.

Ostatecznie Stretch dał światu coś nowego, co nie było dotychczas stosowane w branży komputerowej – ideę standaryzowanych modułów, z których później wyrosła cała branża komponentów na układy scalone. Każda osoba, która idzie do sklepu po nową kartę graficzną NVIDII, a następnie umieszcza ją w miejscu starej karty graficznej ATI i wszystko działa bez problemów, powinna w tym momencie podziękować Johnsonowi i Brookowi. Ci ludzie wymyślili coś bardziej rewolucyjnego (i mniej zauważalnego i od razu docenili, na przykład programiści w ZSRR w ogóle nie zwracali na to uwagi!), niż przenośnik i DMA.

Wynaleźli standardowe kompatybilne płyty.

SMS

Jak już powiedzieliśmy, projekt Stretch był niezrównany pod względem złożoności. Gigantyczna maszyna miała się składać z ponad 170 000 tranzystorów, a także z setek tysięcy innych elementów elektronicznych. Wszystko to musiało być jakoś zamontowane (pamiętaj, jak Yuditsky spacyfikował oporne ogromne tablice, rozbijając je na oddzielne elementarne urządzenia - niestety ta praktyka nie stała się powszechna w ZSRR), debugowana, a następnie obsługiwana, wymieniając wadliwe części. W efekcie twórcy zaproponowali pomysł, który jest oczywisty z wysokości naszych dotychczasowych doświadczeń – najpierw opracować osobne małe klocki, zaimplementować je na standardowych mapach, a następnie złożyć samochód z map.

Tak narodził się SMS - Standardowy System Modularny, który po Stretchu był używany wszędzie.

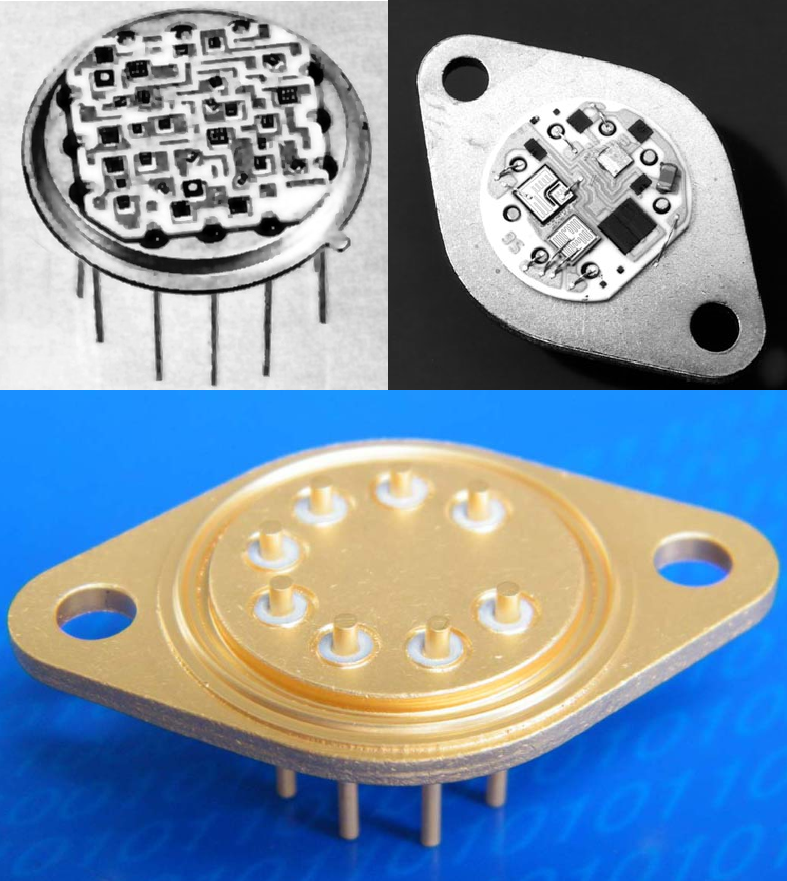

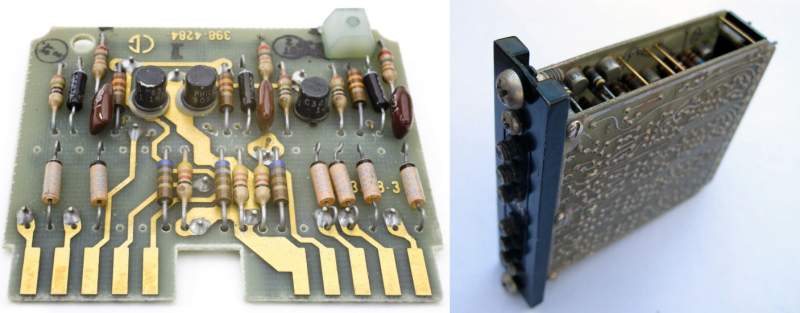

Zawierał dwa składniki. Pierwszą była tak naprawdę sama płytka z podstawowymi elementami o wymiarach 2,5x4,5 cala z 16-pinowym pozłacanym złączem. Były deski o pojedynczej i podwójnej szerokości. Drugi to standardowy uchwyt na karty, z cofniętymi oponami.

Niektóre rodzaje kart można skonfigurować za pomocą specjalnej zworki (tak jak płyty główne są teraz strojone). Ta funkcja miała na celu zmniejszenie liczby kart, które inżynier musiał nosić. Jednak liczba kart szybko przekroczyła 2500 dzięki zaimplementowaniu wielu cyfrowych rodzin logicznych (ECL, RTL, DTL itp.), a także układów analogowych dla różnych systemów. Jednak SMS spełnił swoje zadanie.

Były używane we wszystkich maszynach IBM drugiej generacji oraz w licznych urządzeniach peryferyjnych trzeciej generacji, a także służyły jako prototyp dla bardziej zaawansowanych modułów S/360 SLT. To właśnie ta „tajna” broń, na którą jednak nikt w ZSRR nie zwracał większej uwagi, pozwoliła IBM zwiększyć produkcję swoich maszyn do dziesiątek tysięcy rocznie, o czym wspominaliśmy w poprzednim artykule.

Ta technologia została zapożyczona przez wszystkich uczestników amerykańskiego wyścigu komputerowego - od Sperry po Burroughs. Ich całkowitej produkcji nie można było porównać z ojcami z IBM, ale to pozwoliło w latach 1953-1963 po prostu zapełnić nie tylko amerykański, ale i międzynarodowy rynek komputerami własnej konstrukcji, dosłownie powalając. wszystkich regionalnych producentów stamtąd - od Bull do Olivetti. Nic nie przeszkodziło ZSRR w zrobieniu tego samego, przynajmniej z krajami RWPG, ale, niestety, przed unijną serią idea standardu nie odwiedziła naszych szefów planowania państwowego.

Kompaktowa koncepcja opakowania

Drugim filarem po standaryzacji (która tysiąckrotnie odegrała rolę w przejściu na układy scalone i zaowocowała powstaniem tzw. bibliotek standardowych elementów logicznych, stosowanych bez większych zmian od lat 1960. do dziś!) była koncepcja kompaktowego opakowania, o czym myślano jeszcze przed układami scalonymi, a nawet tranzystorami.

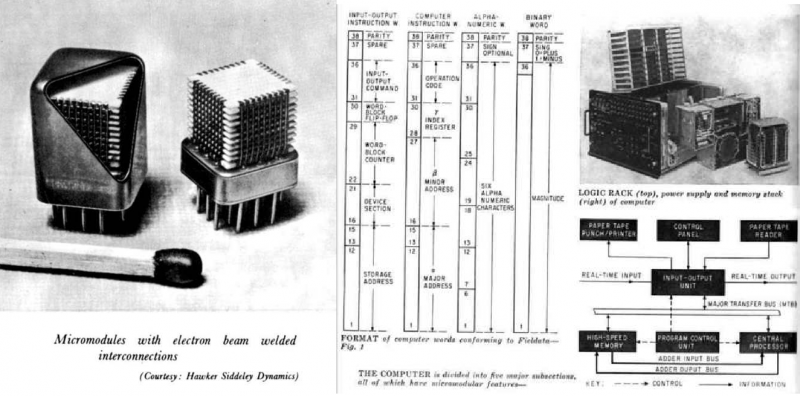

Wojnę miniaturyzacyjną można podzielić na 4 fazy. Pierwszy to pre-tranzystor, kiedy lampy próbowały ujednolicić i zredukować. Drugi to pojawienie się i wprowadzenie płytek drukowanych z montażem powierzchniowym. Trzecim jest poszukiwanie najbardziej kompaktowego pakietu tranzystorów, mikromodułów, obwodów cienkowarstwowych i hybrydowych - ogólnie bezpośrednich przodków układów scalonych. I wreszcie czwarty - sam adres IP. Wszystkie te ścieżki (z wyjątkiem miniaturyzacji lamp) ZSRR przebiegały równolegle z USA.

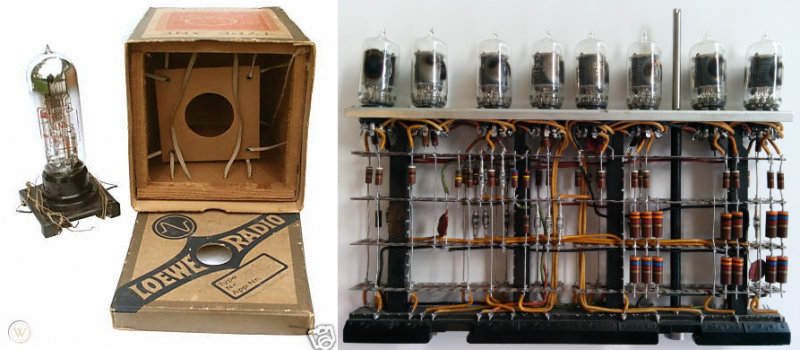

Pierwszym połączonym urządzeniem elektronicznym był rodzaj „zintegrowanej lampy” Loewe 3NF, opracowany przez niemiecką firmę Loewe-Audion GmbH w 1926 roku. Marzenie tego fana ciepłych lamp składało się z aż trzech lamp triodowych w jednej szklanej obudowie, wraz z dwoma kondensatorami i czterema rezystorami potrzebnymi do stworzenia kompletnego odbiornika radiowego. Rezystory i kondensatory zostały zamknięte we własnych szklanych rurkach, aby zapobiec zanieczyszczeniu próżni. W rzeczywistości był to „odbiornik w lampie”, jak nowoczesny system na chipie! Jedyne, co należało kupić oprócz stworzenia radia, to cewka i kondensator strojenia oraz głośnik.

Ten cud techniki powstał jednak nie po to, by zapoczątkować erę układów scalonych kilka dekad wcześniej, ale by uniknąć niemieckich podatków nakładanych na każde gniazdo lampy (podatek od luksusu Republiki Weimarskiej). Odbiorniki Loewe miały tylko jedno złącze, co dawało ich właścicielom niemałe preferencje finansowe. Pomysł powstał w linii 2NF (dwie tetrody plus elementy bierne) oraz monstrualnym WG38 (dwie pentody, trioda i elementy bierne).

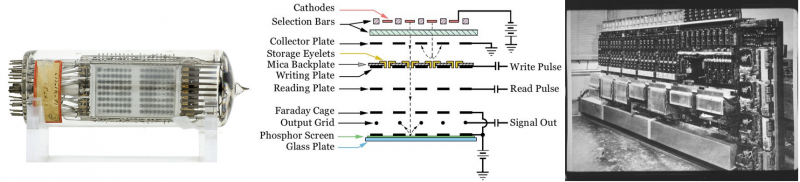

Ogólnie rzecz biorąc, lampy miały ogromny potencjał integracji (chociaż koszt i złożoność projektu wzrosły niebotycznie), szczytem takich technologii był RCA Selectron. Ta monstrualna lampa została opracowana pod kierownictwem Jana Aleksandra Rajchmana, zwanego Panem Pamięcią za stworzenie 6 rodzajów pamięci RAM od półprzewodnikowej po holograficzną.

Jana von Neumanna

Po zbudowaniu ENIAC John von Neumann udał się do Institute for Advanced Study (IAS), gdzie chętnie kontynuował prace nad nowym ważnym (uważał, że komputery są ważniejsze niż bomby atomowe dla pokonania ZSRR) kierunkiem naukowym - komputery. Zgodnie z ideą von Neumanna, zaprojektowana przez niego architektura (później nazwana von Neumanna) miała stać się punktem odniesienia dla projektowania maszyn we wszystkich amerykańskich uniwersytetach i ośrodkach badawczych (tak nawiasem mówiąc, częściowo tak się stało) – znowu pragnienie zjednoczenia i uproszczenie!

Do maszyny IAS von Neumann potrzebował pamięci. A RCA, wiodący producent wszystkich instrumentów próżniowych w USA w tamtym czasie, hojnie zaoferował im sponsorowanie ich lampami Williamsa. Oczekiwano, że włączając je do standardowej architektury, von Neumann pomoże rozpowszechnić je jako standard pamięci RAM, co przyniesie w przyszłości ogromne zyski RCA. Projekt IAS obejmował 40 kb pamięci RAM, sponsorzy z RCA byli nieco zasmuceni takimi apetytami i poprosili dział Reichmanna o zmniejszenie liczby lamp.

Raikhman, z pomocą rosyjskiego emigranta Igora Grozdowa (w sumie w RCA pracowało wielu Rosjan, w tym słynny Zworykin, a sam prezydent David Sarnow był białoruskim Żydem - emigrantem) zrodził zupełnie zdumiewające rozwiązanie - koronę próżni zintegrowana technologia, lampa RAM RCA SB256 Selectron dla 4 kbit! Jednak technologia okazała się szalenie skomplikowana i droga, nawet seryjne lampy kosztowały około 500 USD za sztukę, podstawa ogólnie była potworem z 31 stykami. W rezultacie projekt nie znalazł nabywcy z powodu opóźnień z serią - na nosie była już pamięć ferrytowa.

Projekt Tinkertoy

Wielu producentów komputerów podjęło świadome próby ulepszenia architektury (topologii, której tu jeszcze nie można powiedzieć) modułów lamp w celu zwiększenia ich kompaktowości i łatwości wymiany.

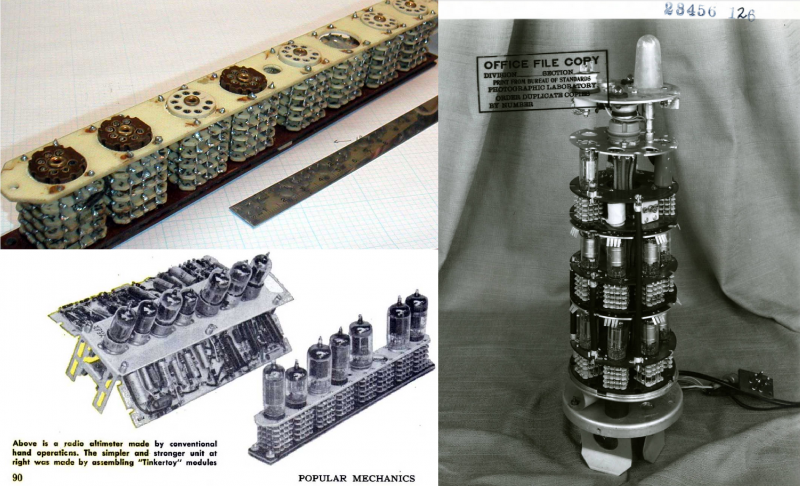

Najbardziej udaną próbą była seria standardowych bloków lamp IBM 70xx. Szczytem miniaturyzacji lamp była pierwsza generacja programu Project Tinkertoy, nazwanego na cześć popularnego projektanta dzieci z lat 1910-1940.

Nie wszystko idzie gładko dla Amerykanów, zwłaszcza gdy rząd zawiera kontrakty. W 1950 r. Biuro Aeronautyki Marynarki Wojennej zleciło Narodowemu Biuru Standardów (NBS) opracowanie kompleksowego systemu komputerowego wspomagania projektowania i produkcji uniwersalnych modułowych urządzeń elektronicznych. W zasadzie w tym czasie było to uzasadnione, ponieważ nikt jeszcze nie wiedział, dokąd poprowadzi tranzystor i jak go właściwie wykorzystać.

NBS wpompował ponad 4,7 miliona dolarów w rozwój (około 60 milionów dolarów według dzisiejszych standardów), entuzjastyczne artykuły opublikowano w czerwcowym wydaniu Popular Mechanics z czerwca 1954 r. oraz w majowym wydaniu Popular Electronics i... rozpylanie oraz serię boi radarowych z lat 1955. wykonanych z tych komponentów.

Co się stało?

Pomysł był fajny – zrewolucjonizować automatyzację produkcji i zamienić masywne bloki a la IBM 701 w kompaktowe i wszechstronne moduły. Jedyny problem polegał na tym, że cały projekt został zaprojektowany z myślą o lampach i zanim został ukończony, tranzystor zaczął już swój zwycięski tor. Nie tylko w ZSRR wiedział, jak się spóźnić - projekt Tinkertoy pochłonął ogromne sumy i okazał się całkowicie bezużyteczny.

Płyty standardowe

Drugie podejście do pakowania polegało na optymalizacji rozmieszczenia tranzystorów i innych elementów dyskretnych na standardowych płytkach.

Do połowy lat 1940. jedynym sposobem na naprawę części (nawiasem mówiąc, dobrze nadających się do energoelektroniki i używanych jako takich teraz) była konstrukcja punkt-punkt. Ten schemat nie był zautomatyzowany i mało niezawodny.

Austriacki inżynier Paul Eisler wynalazł płytkę drukowaną do swojego radia podczas pracy w Wielkiej Brytanii w 1936 roku. W 1941 roku wielowarstwowe płytki drukowane były już używane w niemieckich magnetycznych kopalniach morskich. Technologia dotarła do Stanów Zjednoczonych w 1943 roku i została wykorzystana w bezpiecznikach radiowych Mk53. Płytki PCB stały się dostępne do użytku komercyjnego w 1948 r., a zautomatyzowane procesy montażu (ponieważ komponenty nadal były do nich przymocowane) pojawiły się dopiero w 1956 r. (opracowane przez US Army Signal Corps).

Nawiasem mówiąc, podobną pracę w tym samym czasie w Wielkiej Brytanii wykonywał wspomniany już Jeffrey Dahmer, ojciec układów scalonych. Rząd zaakceptował swoje płytki z obwodami drukowanymi, ale, jak pamiętamy, mikroukłady zostały krótkowzrocznie wycięte.

Do późnych lat sześćdziesiątych i wynalezienia płaskich obudów i złączy panelowych do mikroukładów szczytowym osiągnięciem rozwoju płytek drukowanych we wczesnych komputerach było tak zwane opakowanie z drewna lub kordu. Oszczędza dużo miejsca i jest często stosowany tam, gdzie miniaturyzacja była krytyczna - w produktach wojskowych lub superkomputerach.

W konstrukcji z drewna kordowego elementy z wyprowadzeniami osiowymi zostały zainstalowane pomiędzy dwiema równoległymi płytkami i albo zlutowane przewodami połączeniowymi, albo połączone cienką taśmą niklową. Pomiędzy płytami umieszczono karty izolacyjne, aby uniknąć zwarć, a perforacje umożliwiły przejście elementów składowych do kolejnej warstwy.

Wadą drewna sznurowego było to, że trzeba było użyć specjalnych niklowanych kołków, aby zapewnić niezawodne spawy, rozszerzalność cieplna mogła wypaczać deski (co zaobserwowano w kilku modułach komputera Apollo), a ponadto schemat ten zmniejszał łatwość konserwacji jednostki do poziomu współczesnego MacBooka, ale przed pojawieniem się układów scalonych, cordwood umożliwił osiągnięcie najwyższej możliwej gęstości.

Oczywiście pomysły optymalizacyjne nie skończyły się na planszach.

A pierwsze koncepcje pakowania tranzystorów narodziły się niemal natychmiast po rozpoczęciu ich masowej produkcji. Artykuł BSTJ 31: 3. Maj 1952: Obecny stan rozwoju tranzystorów. (Morton, JA) jako pierwszy opisał badania nad „możliwością wykorzystania tranzystorów jako miniaturowych obwodów w obudowie”. Bell opracował 1752 zintegrowanych pakietów dla swoich wczesnych typów M7, z których każdy zawiera płytkę drukowaną osadzoną w przezroczystym plastiku, ale nic nie wyszło poza prototypy.

W 1957 roku armia amerykańska i NSA ponownie zainteresowały się tym pomysłem i zleciły firmie Sylvania Electronic System opracowanie czegoś w rodzaju miniaturowych, szczelnych modułów z drewna sznurowego do użytku w tajnych pojazdach wojskowych. Projekt nazwano FLYBALL 2, opracowano kilka standardowych modułów zawierających elementy NOR, XOR itp. Stworzone przez Maurice'a I. Crystala znalazły zastosowanie w komputerach kryptograficznych HY-2, KY-3, KY-8, KG-13 i KW-7. Na przykład KW-7 składa się z 12 płyt wtykowych, z których każda może pomieścić do 21 modułów FLYBALL ułożonych w 3 rzędy po 7 modułów każdy. Moduły były wielokolorowe (w sumie 20 typów), każdy kolor odpowiadał za swoją funkcję.

Podobne bloki o nazwie Gretag-Bausteinsystem wyprodukowała firma Gretag AG w Regensdorf (Szwajcaria).

Jeszcze wcześniej, w 1960 r., podobne bloki Serii-1, Serii 40 i NORbit były produkowane przez firmę Philips jako elementy programowalnych sterowników logicznych w celu zastąpienia przekaźników w przemysłowych systemach sterowania, seria miała nawet obwód czasowy podobny do słynnego układu 555. Moduły zostały wyprodukowane przez firmę Philips i jej oddziały Mullard i Valvo (nie mylić z Volvo!) i były wykorzystywane w automatyce fabryk do połowy lat 1970-tych.

Nawet w Danii w maszynie Electrologica X1 w 1958 roku zastosowano miniaturowe wielokolorowe moduły, tak podobne do uwielbianych przez Duńczyków klocków Lego. W NRD, w Instytucie Komputerów Politechniki Drezdeńskiej, w 1959 roku profesor Lehmann (Nikolaus Joachim Lehmann) zbudował dla swoich studentów około 10 miniaturowych komputerów pod oznaczeniem D4a, w których zastosowano podobny pakiet tranzystorów.

Prace poszukiwawcze trwały nieprzerwanie od końca 1940 do końca lat pięćdziesiątych. Problem polegał na tym, że żadne sztuczki korpuskularne nie mogły obejść tak zwanej tyranii liczb, terminu ukutego przez Jacka Mortona, wiceprezesa Bell Labs w artykule z 1950 roku „Proceedings of the IRE”.

Problem polega na tym, że liczba elementów dyskretnych w komputerze osiągnęła limit. Maszyny z ponad 200000 7030 pojedynczych modułów okazały się po prostu niesprawne - pomimo tego, że tranzystory, rezystory i diody były już wtedy wysoce niezawodne. Jednak nawet prawdopodobieństwo awarii w setnych częściach procenta, pomnożone przez setki tysięcy części, dawało dużą szansę, że w dowolnym momencie coś się zepsuje w komputerze. Montaż powierzchniowy z dosłownie kilometrami okablowania i milionami wlutowanych styków jeszcze pogorszył sytuację. IBM 8600 pozostawał granicą złożoności maszyn czysto dyskretnych, nawet geniusz Seymoura Craya nie mógł sprawić, by znacznie bardziej złożony CDC XNUMX działał stabilnie.

Koncepcja obwodów hybrydowych

Pod koniec lat czterdziestych Central Radio Laboratories w Stanach Zjednoczonych opracowały tak zwaną technologię grubowarstwową - ścieżki i elementy pasywne nakładano na podłoże ceramiczne metodą zbliżoną do produkcji płytek drukowanych, a następnie lutowano bezpakietowe tranzystory podłoże i wszystko to zostało zapieczętowane.

W ten sposób narodziła się koncepcja tak zwanych mikroukładów hybrydowych.

W 1954 roku marynarka wojenna zainwestowała kolejne 5 milionów dolarów w nieudany program Tinkertoy, podczas gdy armia dodała do tego 26 milionów dolarów. RCA i Motorola przejęły biznes. Pierwszy poprawił ideę CRL, rozwijając go do tzw. mikroukładów cienkowarstwowych, efektem prac drugiego był m.in. słynny pakiet TO-3 – chyba każdy, kto kiedykolwiek widział każda elektronika natychmiast rozpozna te potężne pociski z uszami. W 1955 roku Motorola wypuściła w nim swój pierwszy tranzystor XN10, a obudowa została dobrana tak, aby pasowała do minipanelu z tuby Tinkertoy, stąd tak rozpoznawalny kształt. Wszedł również do bezpłatnej sprzedaży i był używany od 1956 roku w radiach samochodowych, a potem wszędzie, takie obudowy są nadal używane.

W 1960 hybrydy (ogólnie, jakkolwiek się nazywały - mikrozespoły, mikromoduły itp.) były stale wykorzystywane przez wojsko USA w swoich projektach, wypierając poprzednie niezdarne i ciężkie pakiety tranzystorowe.

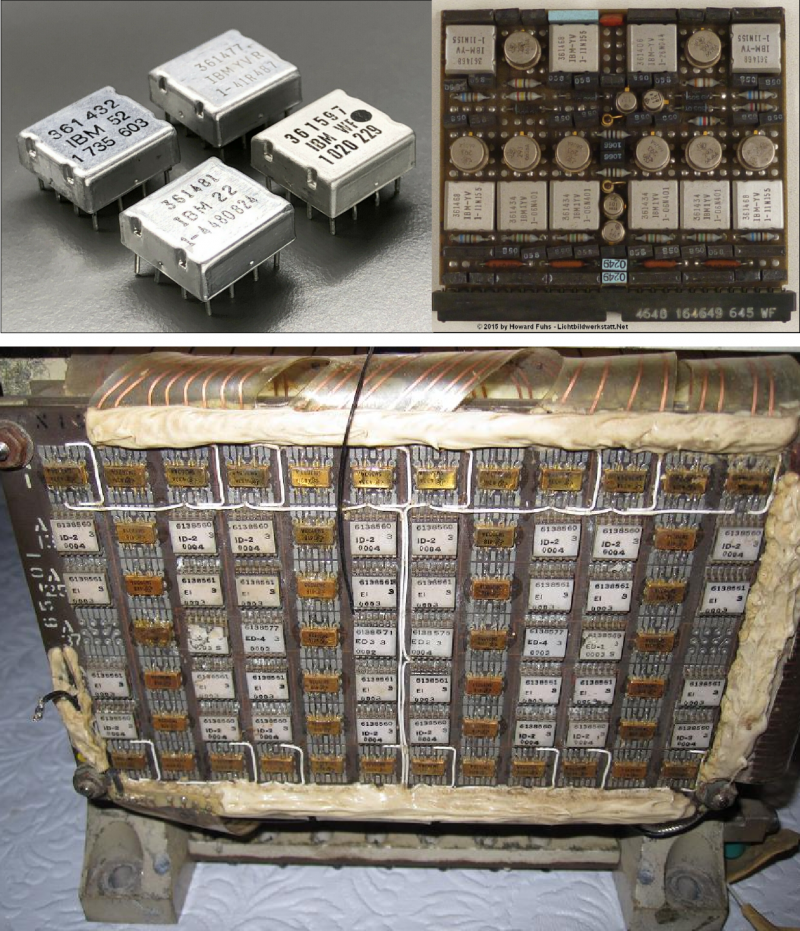

Najlepsza godzina mikromodułów nadeszła już w 1963 roku - IBM opracował również układy hybrydowe dla swojej serii S/360 (która sprzedała milion egzemplarzy, założyła rodzinę kompatybilnych maszyn, produkowanych do tej pory i kopiowanych (legalnie lub nie) wszędzie - od Japonii po ZSRR), którą nazwali SLT.

Układy scalone nie były już nowością, ale IBM słusznie obawiał się o ich jakość i był przyzwyczajony do trzymania w swoich rękach pełnego cyklu produkcyjnego. Postawa była uzasadniona, mainframe nie tylko odniósł sukces, był legendarny, jak IBM PC i dokonał tej samej rewolucji.

Oczywiście w późniejszych modelach, takich jak S/370, firma przeszła już na pełnoprawne mikroukłady, jednak w tych samych markowych pudełkach aluminiowych. SLT były znacznie większą i tańszą adaptacją maleńkich modułów hybrydowych (tylko 7,62x7,62 mm) opracowanych w 1961 roku dla IBM LVDC (komputer pokładowy MBR, a także program Gemini). Co zabawne – układy hybrydowe pracowały tam w połączeniu z już pełnoprawnymi układami scalonymi TI SN3xx.

Jednak flirt z technologią cienkowarstwową, niestandardowymi pakietami mikrotranzystorów i innych rzeczy był początkowo ślepym zaułkiem - półśrodkiem, który nie pozwolił przejść na nowy poziom jakości, dokonując prawdziwego przełomu.

A przełomem miało być radykalne, o rzędy wielkości zmniejszenie liczby elementów dyskretnych i połączeń w komputerze. Potrzebne były nie sprytne montaże, ale monolityczne standardowe produkty, które zastępują całe podkładki desek.

Ostatnią próbą wyciśnięcia czegoś z klasycznej technologii było odwołanie się do tzw. elektroniki funkcjonalnej – próba opracowania monolitycznych urządzeń półprzewodnikowych, które zastępują nie tylko diody i triody próżniowe, ale także bardziej złożone lampy – tyratrony i dekatrony.

W 1952 roku Jewell James Ebers z Bell Labs stworzył czterowarstwowy tranzystor „na sterydach” – tyrystor, analog tyratronu. Shockley w swoim laboratorium od 1956 rozpoczął prace nad dostrojeniem do seryjnej produkcji czterowarstwowej diody - dinistora, ale jego kłótliwy charakter i początkowa paranoja nie pozwoliły mu dokończyć pracy i zrujnowały grupę.

Prace z lat 1955-1958 ze strukturami tyrystorów germanowych nie przyniosły rezultatów. W marcu 1958 r. RCA przedwcześnie ogłosił XNUMX-bitowy rejestr przesuwny Walmarka jako „nową koncepcję w technologii elektronicznej”, ale rzeczywiste obwody tyrystorowe germanu były niewykonalne. Aby rozpocząć ich masową produkcję, potrzebny był dokładnie ten sam poziom mikroelektroniki, co w przypadku obwodów monolitycznych.

Tyrystory i dinistory znalazły zastosowanie w technice, ale nie w technice komputerowej, po tym jak problemy z ich uwalnianiem zostały rozwiązane przez nadejście fotolitografii.

Ta jasna myśl odwiedziła niemal jednocześnie trzy osoby na świecie. Anglik Jeffrey Dahmer (ale jego własny rząd go zawiódł), Amerykanin Jack St. Clair Kilby (Jack St. Clair Kilby, miał szczęście do całej trójki – Nagroda Nobla za stworzenie własności intelektualnej) i Rosjanin – Jurij Walentynowicz Osokin (wynik jest coś pomiędzy Dahmerem a Kilbym: pozwolono mu stworzyć bardzo udany mikroukład, ale ostatecznie nie rozwinęli tego kierunku).

Porozmawiamy o wyścigu o pierwsze przemysłowe IP i o tym, jak ZSRR prawie przejął priorytet w tej dziedzinie, porozmawiamy następnym razem.

informacja